GPT(Generative Pre-trained Transformer)는 디코더만을 활용한 트랜스포머 아키텍처를 기반으로 하는 언어 모델입니다. GPT의 주요 특징과 작동 방식은 다음과 같습니다:

디코더 기반 아키텍처

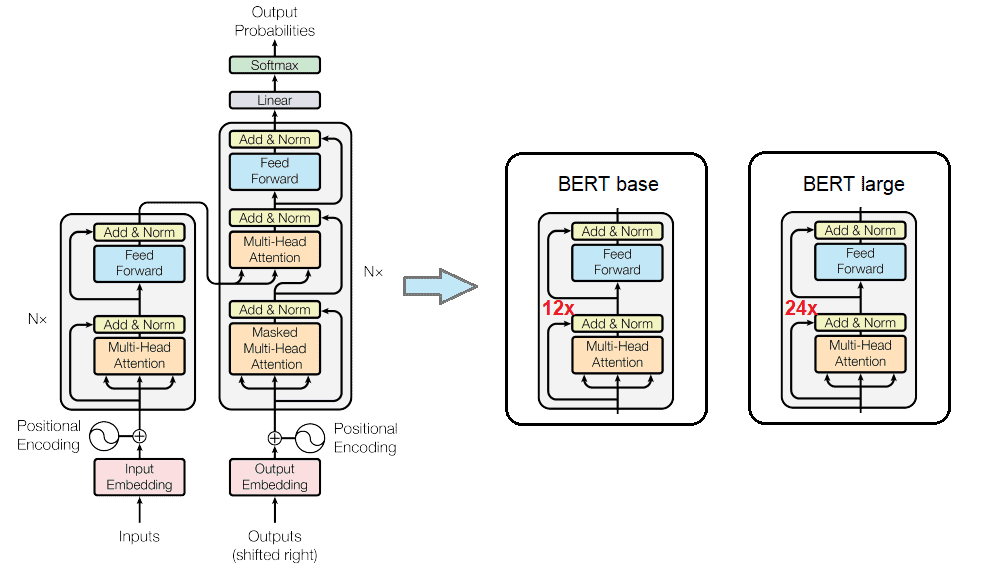

GPT는 트랜스포머의 디코더 부분만을 사용합니다[1]. 이는 인코더-디코더 구조의 전통적인 트랜스포머와는 다른 접근 방식입니다[6].

주요 구성 요소

- 입력 임베딩: 토큰 임베딩과 위치 임베딩을 결합하여 입력 시퀀스를 표현합니다[31].

- 마스크드 멀티헤드 어텐션: 이전 토큰들만을 고려하여 다음 토큰을 예측합니다[22].

- 위치별 피드포워드 신경망: 각 토큰의 표현을 더욱 풍부하게 만듭니다[31].

- 레이어 정규화: 각 서브블록의 입력에 적용되어 학습을 안정화합니다[20].

작동 원리

- 자기회귀적 처리: GPT는 왼쪽에서 오른쪽으로 텍스트를 처리하며, 이전 토큰들을 기반으로 다음 토큰을 예측합니다[5].

- 대규모 사전 학습: 방대한 텍스트 데이터로 사전 학습되어 언어의 패턴과 구조를 학습합니다[28].

- 파인튜닝: 특정 작업에 맞게 모델을 미세 조정할 수 있습니다[33].

GPT의 장점

- 긴 시퀀스 생성: 디코더 구조로 인해 긴 텍스트 생성에 적합합니다[1].

- 유연성: 다양한 자연어 처리 작업에 적용 가능합니다[33].

- 확장성: 더 큰 모델과 더 많은 데이터로 성능을 향상시킬 수 있습니다[33].

GPT의 디코더 기반 아키텍처는 텍스트 생성 작업에 특히 효과적이며, 다양한 응용 분야에서 활용되고 있습니다. 그러나 양방향 문맥 이해가 필요한 일부 작업에서는 BERT와 같은 양방향 모델에 비해 제한적일 수 있습니다[5].

GPT 버전별 비교

Citations:

[1] https://www.exxactcorp.com/blog/deep-learning/gpt-3-vs-bert-llm-comparison

[2] https://bea.stollnitz.com/blog/gpt-transformer/

[3] https://codysolutions.com/blog/the-ultimate-guide-to-chat-gpt-4-features-benefits-and-usage

[4] https://www.streebo.com/chatgpt-manufacturing-use-cases

[5] https://blog.invgate.com/gpt-3-vs-bert

[6] https://www.gptfrontier.com/a-deep-dive-into-gpts-transformer-architecture-understanding-self-attention-mechanisms/

[7] https://gipiti.chat/industries

[8] https://vitalflux.com/bert-vs-gpt-differences-real-life-examples/

[9] https://jalammar.github.io/illustrated-gpt2/

[10] https://dev.to/meetkern/gpt-and-bert-a-comparison-of-transformer-architectures-2k46

[11] https://community.openai.com/t/is-gpt-group-of-models-decoder-only-model/286586

[12] https://www.geeksforgeeks.org/differences-between-gpt-and-bert/

[13] https://www.reddit.com/r/LanguageTechnology/comments/12fhw02/d_why_does_the_decoderonly_architecture_for_the/

[14] https://www.baeldung.com/cs/bert-vs-gpt-3-architecture

[15] https://www.researchgate.net/publication/384690504_GPT-3_Transformer_Decoder_gujoui_bunseoggwa_geu_gyebo

[16] https://www.arxiv.org/pdf/2405.12990.pdf

[17] https://www.linkedin.com/pulse/comparative-analysis-large-language-model-platforms-gpt-shifa-martin-nsjyc

[18] https://www.geeksforgeeks.org/introduction-to-generative-pre-trained-transformer-gpt/

[19] https://indigo.ai/en/blog/gpt4-guida/

[20] https://dugas.ch/artificial_curiosity/GPT_architecture.html

[21] https://www.coursera.org/articles/what-is-gpt

[22] https://bea.stollnitz.com/blog/how-gpt-works-technical/

[23] https://zapier.com/blog/how-does-chatgpt-work/

[24] https://runbear.io/posts/gpt-4-in-action-realworld-examples-of-successful-business-applications

[25] https://www.linkedin.com/pulse/gpt-4-vs-gpt-35-key-advantages-practical-applications-linkenite-pbd0f

[26] https://industrialax.com/solutions/understanding-gpt-agents-functionalities-and-applications-across-industries

[27] https://www.linkedin.com/pulse/potential-applications-gpt-5-various-bdlof

[28] https://aws.amazon.com/what-is/gpt/?nc1=h_ls

[29] https://www.signitysolutions.com/tech-insights/openais-gpt-models-architectural-insights

[30] https://www.ibm.com/think/topics/gpt

[31] https://bea.stollnitz.com/blog/gpt-transformer/

[32] https://www.plainconcepts.com/gpt-4-guide/

[33] https://30dayscoding.com/blog/understanding-the-architecture-of-gpt-models

[34] https://cloud.google.com/discover/what-is-gpt

[35] https://tuyadigital.com/gpt4-vs-gpt3-5/

[36] https://london-data-consulting.com/10-ways-chat-gpt-can-revolutionize-manufacturing/

[37] https://lumenalta.com/insights/what-is-a-custom-gpt-key-features-benefits

[38] https://www.appmatics.com/en/blog/vorteile-nachteile-chat-gpt

답글 남기기